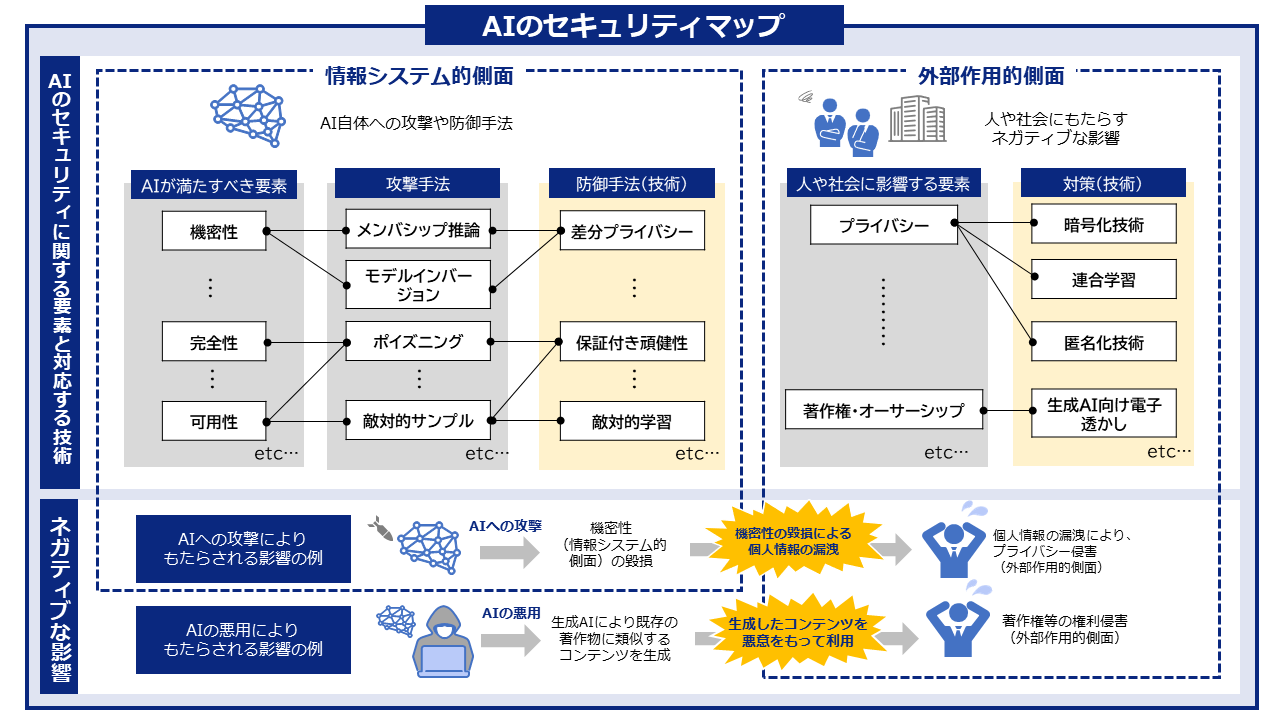

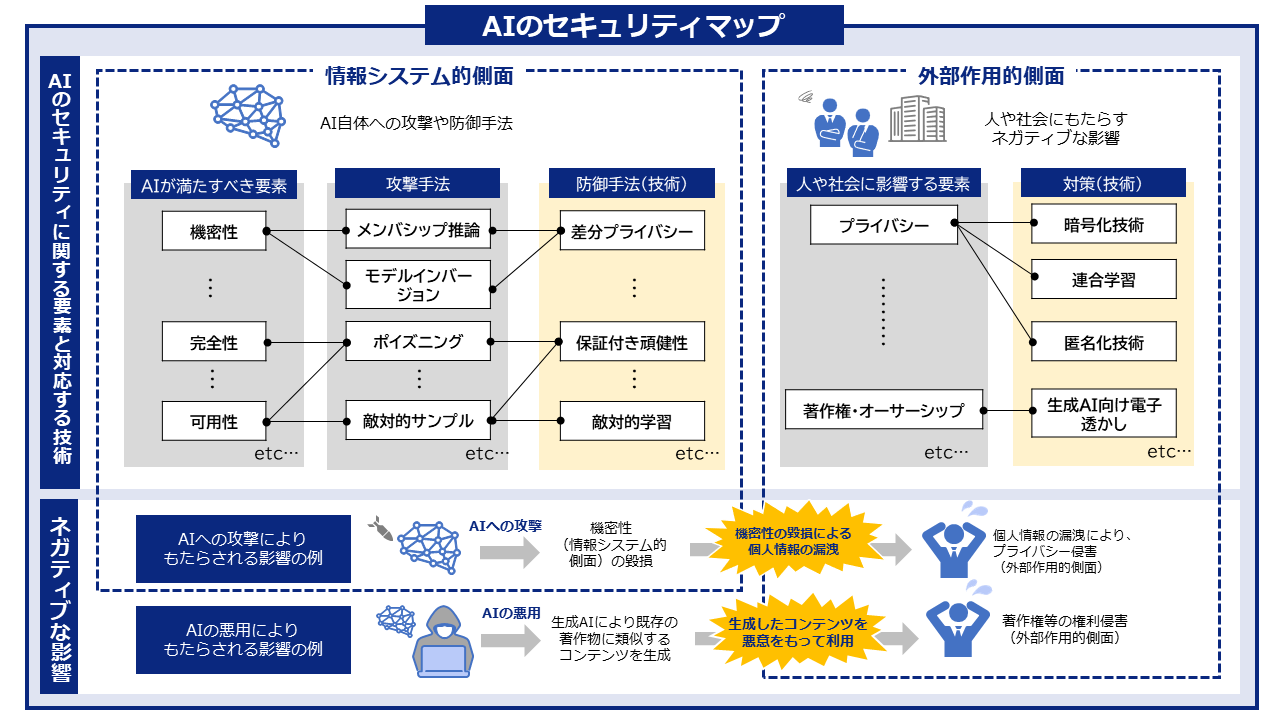

このAIセキュリティマップは、情報システムにおいてAIが満たすべき要素(情報システム的側面)および、AIが攻撃または悪用された結果、人や社会に影響を与える要素(外部作用的側面)で構成されています。2つの側面における負の影響、それをもたらす攻撃・要因、および防御などが整理されています。また、情報システム的側面および外部作用的側面の関係性を体系的に考察し、AIの毀損や悪用がどのように人や社会に影響するかについても整理しています。図1にAIセキュリティマップの概要を示しています。詳細はAIセキュリティマップについてをご覧ください。

図1 AIセキュリティマップの概要

情報システム的側面

| AIが満たすべき要素 | 定義・負の影響 |

|---|---|

機密性

|

定義 AIのデータ・モデルが権限のないものにアクセスされない |

完全性

|

定義 AIのモデルやアルゴリズムが改ざんされておらず、AIの出力が期待された通りのものである |

可用性

|

定義 AIが必要な時に必要な機能やサービスを提供できる |

説明可能性

|

定義 AIが出力の根拠や経緯を説明できる 負の影響 |

出力の公平性

|

定義 AIが特定の人や集団に偏った出力をしない 負の影響 |

安全性

|

定義 AIが人の生命・身体・財産・精神に危害を及ぼさないように安全機構が設定されている |

精度

|

定義 AIが目標達成のための一定の精度を満たす 負の影響 |

制御可能性

|

定義 AIが管理者によって制御されていて、暴走したり、他の環境に影響を与えない 負の影響 |

信頼性

|

定義 AIからの出力が信頼できるものである 負の影響 |

外部作用的側面

| 人や社会に影響する要素 | 定義・負の影響 |

|---|---|

サイバー攻撃

|

定義 AIがサイバー攻撃のために利用されない 負の影響 |

軍事利用

|

定義 AIが軍事利用されない 負の影響 |

プライバシー

|

定義 AIがプライバシーを侵害せず、プライバシーに関する法や慣習を遵守する |

偽情報

|

定義 AIを使って偽情報を意図的に作成しない、または、それらを識別できる 負の影響 |

誤情報

|

定義 AIが誤情報を出力しない、または、それらを識別できる 負の影響 |

ユーザビリティ

|

定義 AIが目標達成のための一定のユーザビリティを満たす 負の影響 |

消費者の公平性

|

定義 AIの不当な偏りのある出力により不利益を被らない |

盗作

|

定義 AIが盗作のために利用されない |

著作権・オーサーシップ

|

定義 AIが著作権・オーサーシップに関する法や慣習に従う |

透明性

|

定義 システムがAIを利用しているという事実やAIの限界やAI利用時のリスクなどの情報が明示されている 負の影響 |

レピュテーション

|

定義 AIシステム提供者が一定の評価をされ、信頼される 負の影響 |

法令の遵守

|

定義 AIが法を遵守した目的で利用され、かつ、法を遵守した出力や動作を行う |

人間中心の原則

|

定義 AIが人間のために適切に利用される |

倫理性

|

定義 AIが社会の規範に照らしてよい振る舞いをする 負の影響 |

経済

|

定義 AIの利活用が経済の成長にプラスに寄与する 負の影響 |

物理的影響

|

定義 AIの利活用が人に物理的な悪影響を与えない |

精神的影響

|

定義 AIの利活用が人に精神的な悪影響を与えない |

金銭的影響

|

定義 AIの利活用が人に金銭的な悪影響を与えない |

医療

|

定義 AIの利活用が高度で安全な医療の発展に寄与する 負の影響 |

基幹インフラ

|

定義 AIの利活用が基幹インフラの安全な運用に寄与する 負の影響 |

-scaled.png)